Comunicado de Prensa

Xbox lanzó su primer Informe sobre transparencia de Xbox, que presenta números claros y explicaciones detrás del trabajo que se realiza para proteger a los jugadores y moderar el contenido en la plataforma. Desde Xbox se comprometen a publicar un informe cada seis meses, en el que se compartirán actualizaciones sobre el progreso realizado.

En el último Índice de Civilidad Digital de Microsoft, se observó que 9 de cada 10 encuestados señalaron la necesidad de una mayor educación sobre cómo hacer que el mundo digital sea más seguro y, como todos saben, los videojuegos son uno de los entornos digitales más grandes que existen.

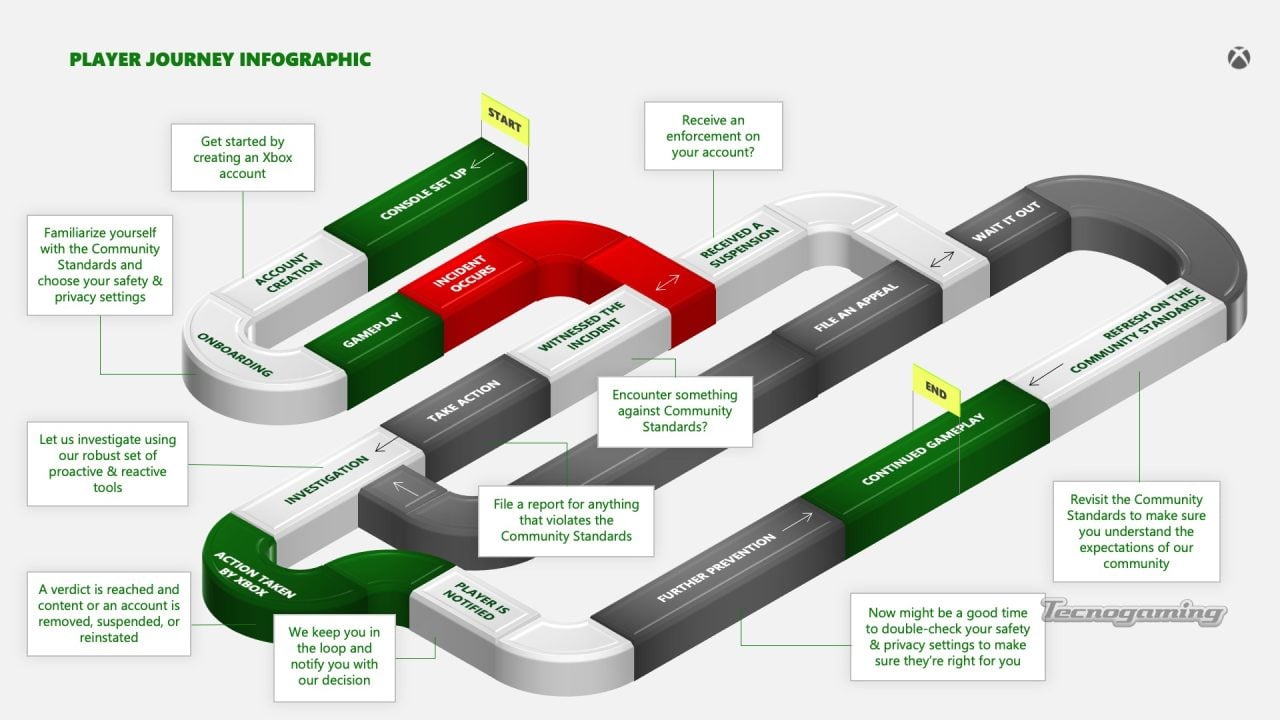

Este informe complementa la revisión continua de los Estándares de la comunidad, lo que facilitará que todos los jugadores puedan identificar lo que es y no una conducta aceptable; refuerza la inversión continua en herramientas de moderación; y promueve una continua colaboración con asociaciones de la industria, reguladores y la comunidad.

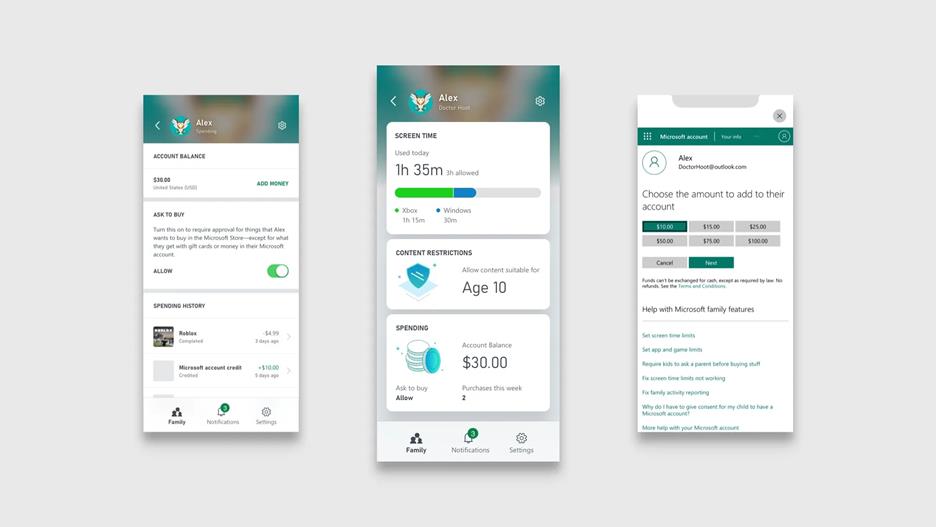

En los últimos años, Xbox invirtió en características y capacidades que contribuyen a hacer que la experiencia del jugador sea más segura, como la Aplicación de Configuración familiar de Xbox, que les brinda a los padres y cuidadores una excelente alternativa para administrar la experiencia de sus hijos en Xbox, adquiriendo un líder de administración comunitaria como Two Hat. Gracias a ello se incorporó su tecnología Community Sift y los especialistas dedicados en idiomas y cultura a la cartera de seguridad de Xbox.

Para dar un pantallazo general sobre un informe profundo y minucioso destacamos los siguientes puntos clave:

- Se tomaron medidas para ofrecer mejores experiencias – El equipo de Xbox emitió más de 4.33 millones de ejecuciones proactivas contra cuentas no auténticas, lo que representa 57 % de las ejecuciones totales en el periodo del informe. Las cuentas no auténticas suelen ser cuentas automatizadas o creadas por bots que crean un campo de juego desigual y pueden restar valor a las experiencias positivas de los jugadores. Esta moderación proactiva, 9 veces superior a la del mismo periodo del año pasado, permite detectar contenido y conductas negativas antes de que lleguen a los jugadores. Así se sigue invirtiendo y mejorando la tecnología para que los jugadores puedan tener experiencias seguras, positivas y atractivas.

- Los jugadores son administradores de la comunidad – La notificación de los jugadores es un componente fundamental dentro del enfoque de seguridad. Junto con mayores medidas de seguridad proactivas, las inversiones en tecnologías de escaneo y filtrado y la educación de la comunidad Xbox Ambassadors, los informes ayudan a mejorar el trabajo para proteger a los jugadores. Los jugadores proporcionaron más de 33 millones de informes este periodo, y las comunicaciones (46 %) y la conducta (43 %) representaron las principales preocupaciones de los jugadores. Los agentes de moderación de contenido están en servicio las 24 horas del día, los 7 días de la semana, los 365 días del año para asegurarse de que el contenido y la conducta que se encuentran en la plataforma cumplan con los Estándares de la comunidad.

- Los jugadores tienen el control – Cada jugador es diferente, por lo que las preferencias sobre el contenido y experiencias no son las mismas para todos. Por eso Xbox ofrece una gran variedad de formas para que los jugadores personalicen la configuración, desde filtros de mensajes hasta controles parentales, en cualquier momento de su experiencia. Esta configuración les permite a los jugadores administrar el tipo de contenido que ven y experimentan en todas las formas en que juegan, ya sea en PC, consola o en cualquier lugar con Xbox Cloud Gaming (Beta).

Interfaz de usuario gráfica, Aplicación

La comunidad de Xbox es tan fuerte como los miembros de la comunidad, y los comentarios e informes que se brindan por parte de ella ayudan a dar forma a la plataforma. Por eso, Xbox invita a la comunidad a que sigan compartiendo sus comentarios a través del programa Xbox Insiders o en el sitio web de Soporte de Xbox.