La última incorporación a la plataforma de computación acelerada de NVIDIA Tesla, Tesla P100 permite una nueva clase de servidores que pueden ofrecer el rendimiento de cientos de nodos de servidores de CPU. Los centros de datos de hoy en día – vastas infraestructuras de redes con numerosos servidores de CPU genéricos interconectados, procesan una gran cantidad de cargas de trabajo transaccionales, como servicios web. Pero son ineficientes para la próxima generación de aplicaciones científicas y de inteligencia artificial, que requieren nodos de servidores ultra eficientes y ágiles.

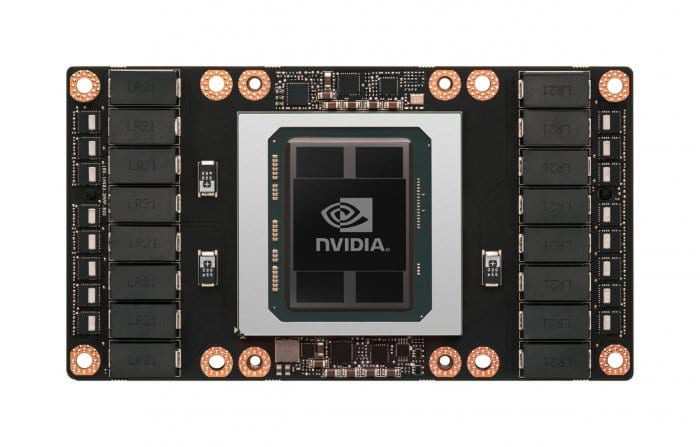

Basado en la nueva arquitectura de GPU NVIDIA Pascal™ con cinco tecnologías de vanguardia, el Tesla P100 ofrece rendimiento y eficiencia inigualables y la potencia para las aplicaciones informáticas más exigentes.

“Nuestros mayores desafíos científicos y técnicos (encontrar la cura para el cáncer, comprender el cambio climático, construir máquinas inteligentes) exigen una cantidad casi infinita de rendimiento informático”, dijo Jen-Hsun Huang, CEO y cofundador de NVIDIA. “Hemos diseñado la arquitectura de GPU Pascal desde el principio, con innovación a todo nivel. Representa un gran avance en el rendimiento informático y la eficiencia, y ayudará a algunas de las mentes más brillantes a desarrollar futuras innovaciones”.

El Dr. John Kelly III, Vicepresidente Senior de Cognitive Solutions e IBM Research, expresó: “A medida que nos adentramos en esta nueva era de la informática, se necesitarán enfoques enteramente nuevos de las tecnologías subyacentes para obtener plenamente los beneficios de la IA y la informática cognitiva. La combinación de las GPU NVIDIA y de la tecnología OpenPOWER ya está acelerando el aprendizaje de nuevas habilidades de Watson. En conjunto, la arquitectura Power de IBM y la arquitectura Pascal de NVIDIA con NVLink acelerarán aún más el rendimiento de las cargas de trabajo cognitivas e impulsarán la industria de la inteligencia artificial”.

Cinco innovaciones en la arquitectura

Tesla P100 ofrece rendimiento sin precedentes, escalabilidad y eficiencia de programación con base en cinco innovaciones:

- Arquitectura Pascal de NVIDIA para un salto exponencial del rendimiento: Una solución Tesla P100 basada en Pascal ofrece un aumento de más de 12 veces en el rendimiento de entrenamiento de redes neuronales en comparación con la generación anterior de soluciones basadas en NVIDIA Maxwell™

- NVIDIA NVLink para una máxima escalabilidad de las aplicaciones: Las interconexiones de GPU de alta velocidad NVIDIA NVLink™ amplían las aplicaciones a través de múltiples GPU, lo que ofrece una aceleración de 5 veces del ancho de banda en comparación con la mejor solución de su clase en la actualidad.1 Se pueden interconectar hasta 8 GPU Tesla GPU P100 con NVLink para maximizar el rendimiento de las aplicaciones en un solo nodo, e IBM ha implementado NVLink en sus CPU POWER8 para comunicación de CPU a GPU veloz.

- FinFET de 16 nm para eficiencia energética sin precedentes: Con 15,3 mil millones de transistores construidos con tecnología de fabricación de FinFET de 16 nanómetros, la GPU Pascal es el chip FinFET más grande del mundo jamás construido.2 Está diseñado para ofrecer el rendimiento más rápido y la mejor eficiencia energética para las cargas de trabajo con necesidades informáticas casi infinitas.

- CoWoS con HBM2 para cargas de trabajo de Big Data: La arquitectura Pascal unifica el procesador y los datos en un único paquete para ofrecer eficiencia de procesamiento sin precedentes. Con un enfoque innovador en el diseño de la memoria, chip sobre oblea sobre sustrato (CoWoS) con HBM2, proporciona un impulso de 3 veces del rendimiento del ancho de banda de la memoria, o de 720 GB/s, en comparación con la arquitectura Maxwell.

- Nuevos algoritmos de inteligencia artificial para obtener el máximo rendimiento: Las nuevas instrucciones de semiprecisión ofrecen más de 21 teraflops de rendimiento máximo para el aprendizaje profundo.

El acelerador de GPU Tesla P100 ofrece un nuevo nivel de rendimiento para una amplia gama de aplicaciones de HPC y de aprendizaje profundo, incluyendo el código de dinámica molecular AMBER, que se ejecuta con mayor rapidez en un único nodo de servidor con GPU Tesla P100 que en 48 nodos de servidores de CPU de doble sockets.3 El entrenamiento de la red neuronal profunda AlexNet popular necesitaría 250 nodos de servidores de CPU de doble sockets para igualar el rendimiento de 8 GPU Tesla P100.4 Y la ampliamente utilizada aplicación de pronóstico meteorológico, COSMO, funciona más rápido en ocho GPU Tesla P100 que en 27 servidores de CPU de dos sockets.5

El primer acelerador en entregar más de 5 y 10 teraflops de rendimiento de precisión doble y de precisión simple, respectivamente, el Tesla P100 ofrece un salto gigante en capacidades de procesamiento y en tiempos de descubrimiento para la investigación en un amplio espectro de dominios.

Actualizaciones al SDK de NVIDIA

NVIDIA también anunció una serie de actualizaciones del SDK de NVIDIA, la plataforma de desarrollo para informática de GPU más potente del mundo.

Estas actualizaciones incluyen NVIDIA CUDA® 8. La última versión de la plataforma informática en paralelo de NVIDIA les proporciona a los desarrolladores acceso directo a las nuevas y potentes características de Pascal, como memoria unificada y NVLink. También se incluye en esta versión una nueva biblioteca de análisis de gráficos, nvGRAPH, que se puede utilizar para la planificación de ruta en robótica, ciberseguridad y análisis de logística, lo que amplía la aplicación de la aceleración de la GPU al ámbito del análisis de Big Data.

NVIDIA también anunció cuDNN versión 5, una biblioteca acelerada por GPU de primitivas para redes neuronales profundas. cuDNN 5 incluye soporte para GPU Pascal; aceleración de redes neuronales recurrentes, que se utilizan para video y otros datos secuenciales; y mejoras adicionales utilizadas en medicina, petróleo y gas, y otras industrias. cuDNN acelera los principales marcos de aprendizaje profundo, como Google TensorFlow, UC Berkeley Caffe, Theano de la Universidad de Montreal y Torch de la NYU. Estas, a su vez, alimentan soluciones de aprendizaje profundo utilizadas por Amazon, Facebook, Google y otros.

Especificaciones de Tesla P100

Las especificaciones del acelerador de GPU Tesla P100 incluyen:

- 5,3 teraflops de rendimiento de precisión doble, 10,6 teraflops de rendimiento de precisión simple y 21,2 teraflops de rendimiento de semiprecisión con tecnología NVIDIA GPU BOOST™

- 160 GB/s de ancho de banda de interconexión bidireccional con NVIDIA NVLink

- 16 GB de memoria apilada CoWoS HBM2

- 720 GB/s de ancho de banda de memoria con memoria apilada CoWoS HBM2

- Programabilidad mejorada con motor de migración de páginas y memoria unificada

- Protección ECC para mayor confiabilidad

- Servidor optimizado para confiabilidad y rendimiento máximos del centro de datos

Disponibilidad

La fecha de disponibilidad general para el acelerador de GPU NVIDIA Tesla P100 basado en Pascal en el nuevo sistema de aprendizaje profundo NVIDIA DGX-1™ es junio. También se prevé que estará disponible desde principios de 2017 a través de los principales fabricantes de servidores.